مترجم جوجل العالمي, بمناسبة العرض التقديمي الذي تقدم كعمل متوازن في واجب الحذر والحاجة إلى المضي قدمًا ، قدم عملاق ماونتن فيو أداة يمكن أن تحدث ثورة في التدريس ، على سبيل المثال ، ولكنها أيضًا أصبحت مصنع الأخبار المزيفة في نهاية المطاف.

يجب أن يكون الذكاء الاصطناعي “جريئًا ومسؤولًا”. هذه هي الفكرة المهيمنة التي تخللت الكلمة الافتتاحية لـ Google I / O بالأمس. وفي دور صاحب الرؤية المغامرة ، ولكن على دراية بعبئه ، كان جيمس مانيكا ، رئيس قسم التكنولوجيا والمجتمع بشركة ماونتن فيو العملاقة ، هو الذي أتيحت له الفرصة للتحدث عن مخاطر وواجبات Google.

مترجم جوجل العالمي

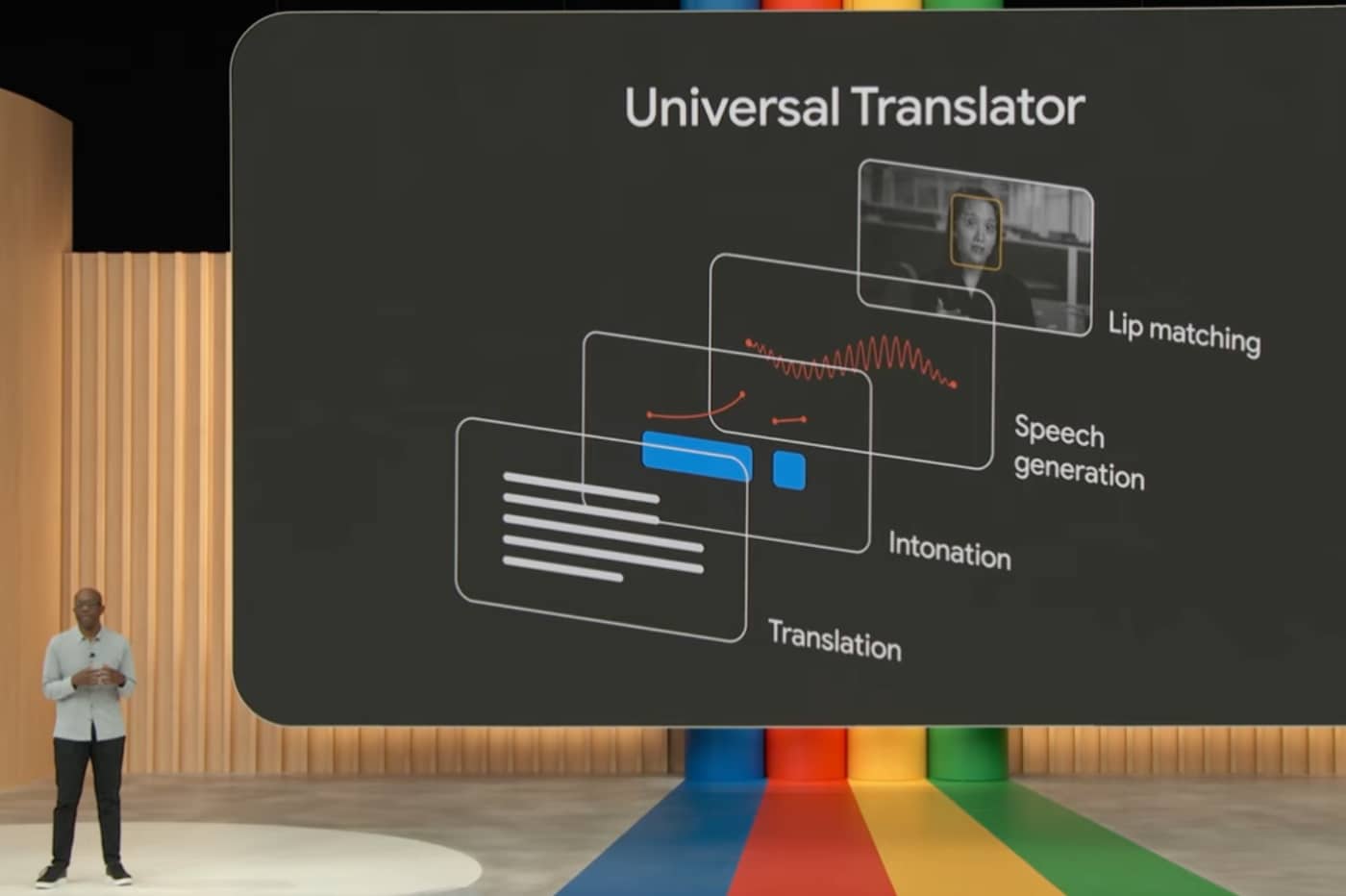

وكان أيضًا هو الشخص الذي قدم المترجم العالمي. أداة تشبه الثورة أو صندوق باندورا ، في عالم الأخبار المزيفة والتزييف العميق. في سياق المثال المقدم ، يسمح بالفعل من مقطع فيديو مسجل باللغة الإنجليزية ، دورة في هذه الحالة ، بنسخ محتوى الفيديو ، ثم ترجمته.

حتى الآن ، لا شيء خارج عن المألوف. سيقوم بعد ذلك بإعادة إنتاج نغمات المتحدث وتطبيقها على صوت اصطناعي بلغة أخرى ، باللغة الإسبانية لأغراض العرض التوضيحي. هذا مثير للإعجاب ، لكنه ليس بالضرورة مقلقًا في حد ذاته. في الخطوة التالية تتعقد الأمور.

في الواقع ، سوف تتأكد Universal Translator من مزامنة حركات شفاه المتحدث الأصلي ، الشخص الذي تم تصويره في الفيديو ، بحيث يعطي الانطباع بأنه نطق الرسالة بلغة الوجهة … تطبيقات الحالات هي عديدة ، سواء في مجال التعليم أو الأعمال ، لكن هذا الحاجز الجديد الذي يتم محوه بين الواقع الحقيقي والواقع المعدل يكشف بوضوح هنا أن هناك احتمالًا للمشاكل وسوء المعاملة ، حتى لو لم يكن كل شيء هو الأمثل تقنيًا حتى الآن.

أخبار جيدة ، Google أيضًا. تحدث جيمس مانيكا عن “التوتر بين الجرأة والمسؤولية”. ولهذا أعلن منذ البداية أن الخدمة ليست فقط تجريبية تمامًا ، ولكن لم يكن القصد منها أن تكون في متناول الجميع ، ولكن لشركاء مختارين فقط.

يمكننا أيضًا أن نأمل في أن يخضع تطوير هذا المشروع للشوكات الذيلية للقواعد السبعة المتعلقة بالذكاء الاصطناعي التي سنتها Google في عام 2018.

- أن تكون مفيدة اجتماعيا

- تجنب خلق أو تعزيز التحيزات

- يتم تصميمها واختبارها مع مراعاة السلامة

- كن مسؤولاً أمام المستخدمين

- دمج مبادئ احترام الخصوصية

- الحفاظ على متطلبات التميز العلمي

- تكون متاحة للاستخدامات المتوافقة مع هذه المبادئ.

هذه المبادئ نفسها للذكاء الاصطناعي التي ذكرها جيمس مانيكا بعد بضع دقائق ، تساعد العملاق على “تقرير ما لا يجب فعله”. كانت هذه المبادئ هي التي منعت Google من الدخول في واجهات برمجة التطبيقات العامة للتعرف على الوجه منذ سنوات ، على سبيل المثال ، أوضح ، لأن “الضمانات في ذلك الوقت لم تكن جيدة بما يكفي”.

نفس المبادئ التي منعت Google من الضغط على زر التشغيل في مكافئ ChatGPT قبل OpenAi أيضًا؟ ربما. أحد الحلول ، بالنسبة لجيمس مانيكا ، هو “مواجهة التحديات التي تظهر عندما تظهر” من خلال الابتكار واحترام أخلاقيات معينة قد تبدو مثل “لا تكن شريرًا”.

على أي حال ، في ظل هذه المبادئ ، كانت Google قد صممت Universal Translator مع ضمانات لتجنب الاستخدامات الخطرة. علاوة على ذلك ، يجب أن تخضع مقاطع الفيديو التي تتم معالجتها للاحتياطات التي أعلنها جيمس مانيكا. وبالتالي ، يجب على Google قريبًا “دمج الابتكارات الجديدة في وضع العلامات المائية في أحدث نماذجها التوليدية للمساعدة في الحماية من المعلومات المضللة”.

إذا كان من الصعب معرفة ما الذي ستتكون منه كل هذه الإجراءات الوقائية بالضبط ، وإذا قالت Google بالطبع إنها تريد التحكم في استخدامات تقنيتها ، فمن الضروري أن تضع في اعتبارك تسرب نموذج الذكاء الاصطناعي من Meta في بداية الربيع الماضي. التسريب الذي فتح الباب لسوء المعاملة من جهة ، ولكنه عمل أيضًا كمسرّع للقضية بفضل عالم المصدر المفتوح الذي استولى عليه من جهة أخرى. الشر وجيد ، مرة أخرى.

تعرف Google هذا ، وتسعى إلى العمل في المنبع لحماية نفسها ، وتجنب الأسوأ ، في سياق يبدو أنه من المستحيل فيه فرض حظر على مجال يتطور بسرعة ويتعرض للمضايقة بسبب القضايا الجيوستراتيجية الرأسمالية.

في النهاية ، نعود دائمًا إلى حافة ماكينة الحلاقة هذه بين الجرأة والمسؤولية. وهكذا فإن Universal Translator لديه كل شيء من صندوق Pandora. دعونا لا ننسى أنه في أسفل هذا الصندوق الأسطوري يخفي الأمل دائمًا.

المصدر: Google I / O 2023 Opening Conference